pyenv로 Mac M1 Python 개발환경 세팅하기 — AI 프로젝트 6단계 실전 구성

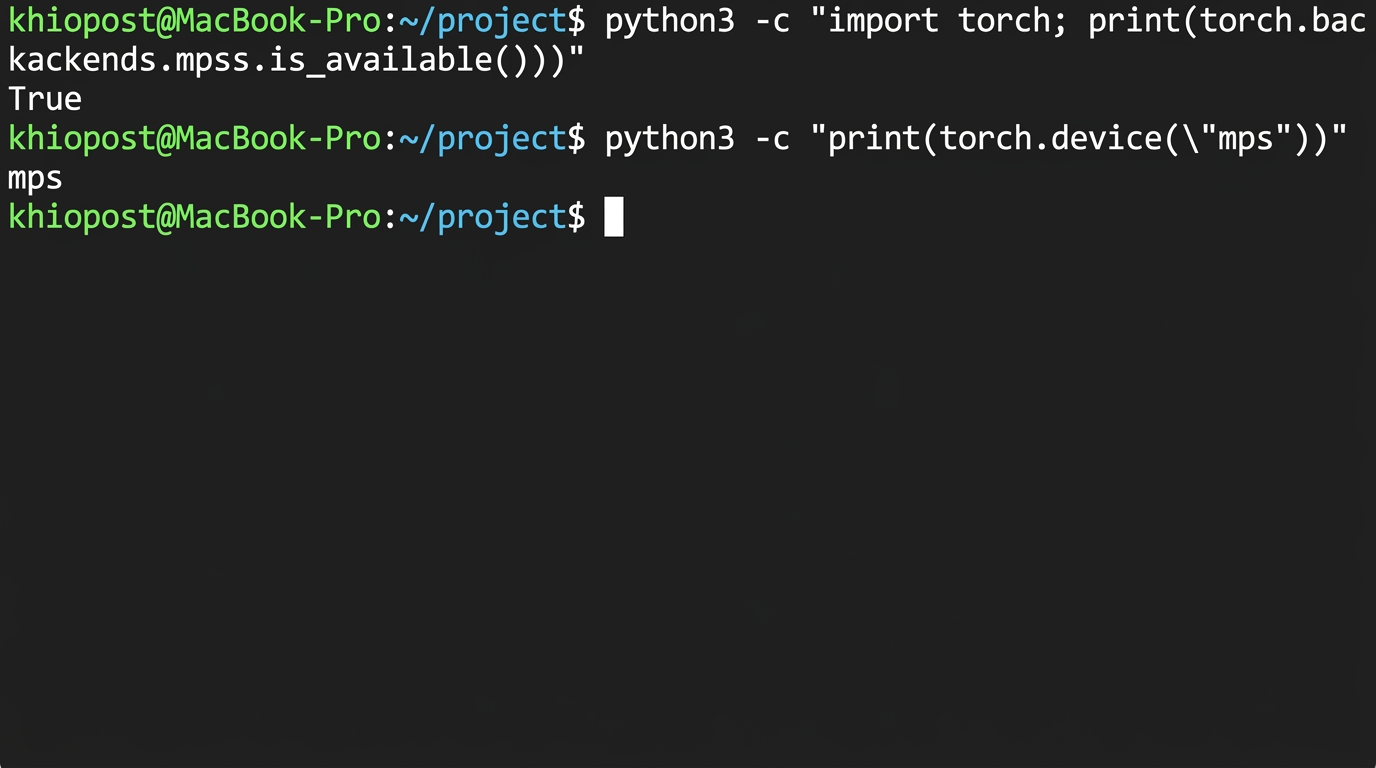

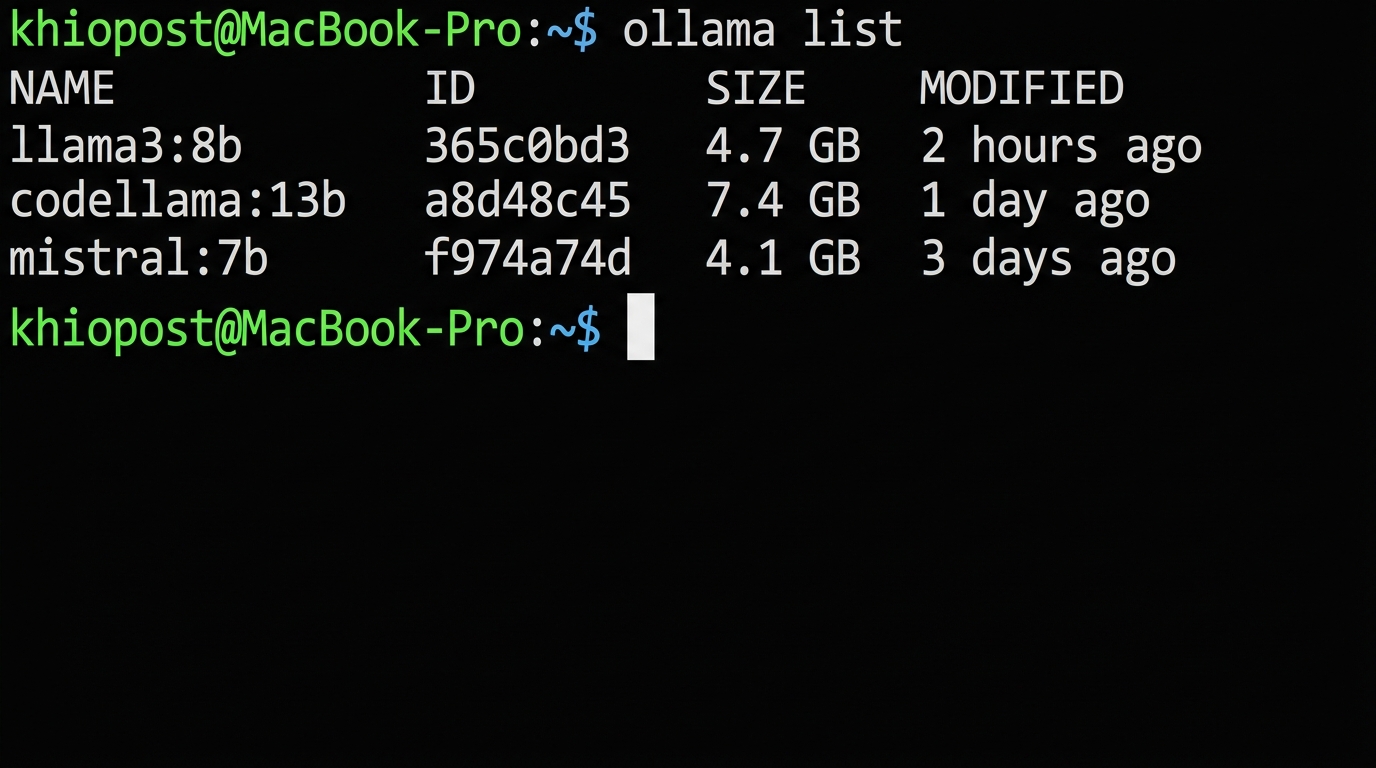

MacBook M1을 사서 AI 프로젝트를 시작하려고 했는데, Python 설치부터 막혔다. 시스템 Python은 건드리면 안 된다고 하고, Homebrew로 설치한 Python은 버전 관리가 안 되고, conda는 왜 그렇게 느린지 모르겠고. PyTorch를 설치했더니 CPU 모드로만 돌아가서 M1 칩을 산 의미가 없어지고. 결국 한 주 정도 삽질한 끝에 pyenv + venv + Metal 가속이라는 조합에 정착했다. M1 32GB RAM … 더 읽기